Hoy en NetApp Insight, la empresa anunció que se asociará con la empresa de infraestructura de virtualización de IA, Run:AI, para permitir una experimentación de IA más rápida con la utilización completa de la GPU. Las dos compañías acelerarán la IA ejecutando muchos experimentos en paralelo, con acceso rápido a los datos, utilizando recursos informáticos ilimitados. El objetivo es el mejor de todos los mundos: experimentos más rápidos mientras se aprovechan todos los recursos.

Hoy en NetApp Insight, la empresa anunció que se asociará con la empresa de infraestructura de virtualización de IA, Run:AI, para permitir una experimentación de IA más rápida con la utilización completa de la GPU. Las dos compañías acelerarán la IA ejecutando muchos experimentos en paralelo, con acceso rápido a los datos, utilizando recursos informáticos ilimitados. El objetivo es el mejor de todos los mundos: experimentos más rápidos mientras se aprovechan todos los recursos.

La velocidad se ha convertido en un aspecto crítico de la mayoría de las cargas de trabajo modernas. Sin embargo, la experimentación con IA está un poco más ligada a la velocidad, ya que cuanto más rápida es la experimentación, más cerca están los resultados comerciales exitosos. Si bien esto no es un secreto, los proyectos de IA sufren procesos que los hacen menos eficientes, principalmente la combinación de tiempo de procesamiento de datos y soluciones de almacenamiento obsoletas. Otros problemas que pueden limitar la cantidad de experimentos ejecutados son los problemas de organización de la carga de trabajo y la asignación estática de los recursos informáticos de la GPU.

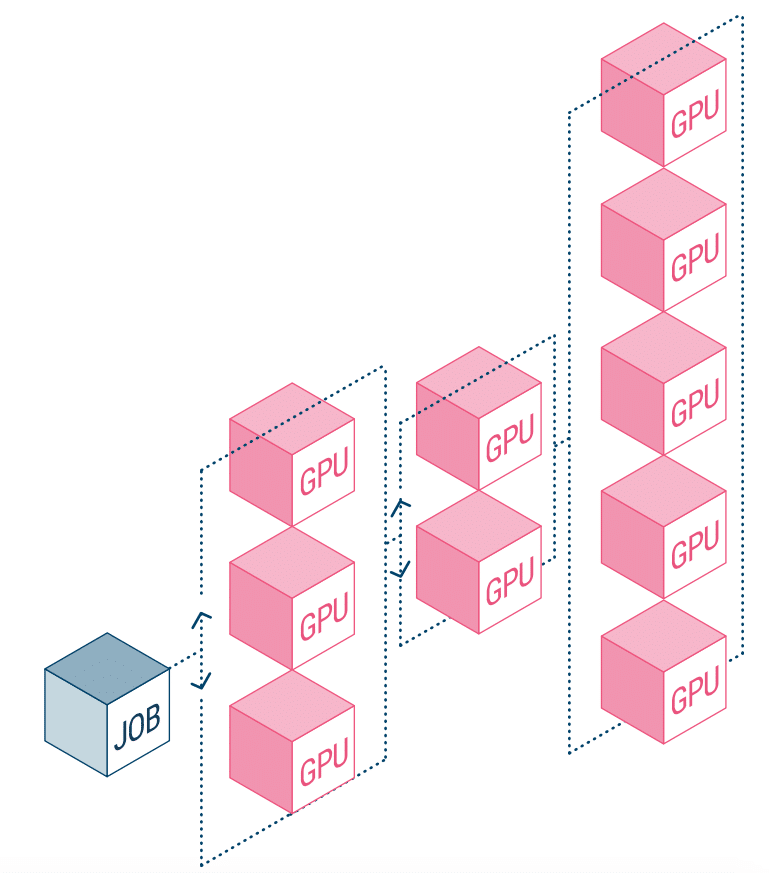

NetApp AI y Run:AI se asocian para abordar lo anterior. Esto significa una simplificación de la orquestación de las cargas de trabajo de IA, agilizando el proceso de las canalizaciones de datos y la programación de máquinas para el aprendizaje profundo (DL). Con la arquitectura probada de ONTAP AI de NetApp, la empresa afirma que los clientes pueden aprovechar mejor la IA y la DL simplificando, acelerando e integrando su flujo de datos. En el lado de Run:AI, su orquestación de cargas de trabajo de IA agrega una plataforma patentada de utilización de recursos y programación basada en Kubernetes para ayudar a los investigadores a administrar y optimizar la utilización de GPU. La tecnología combinada permitirá que varios experimentos se ejecuten en paralelo en diferentes nodos de cómputo, con acceso rápido a muchos conjuntos de datos en almacenamiento centralizado.

Run:AI creó lo que llama la primera plataforma de orquestación y virtualización del mundo para infraestructura de IA. Abstraen la carga de trabajo del hardware y crean grupos compartidos de recursos de GPU que se pueden aprovisionar dinámicamente. Ejecutar esto en los sistemas de almacenamiento de NetApp permite a los investigadores concentrarse en su trabajo sin preocuparse por los cuellos de botella.

Interactuar con StorageReview

Boletín | YouTube | Podcast iTunes/Spotify | Instagram | Twitter | Facebook | RSS Feed