Arista Networks ha annunciato una dimostrazione tecnologica innovativa per creare data center AI che allineano i domini di elaborazione e di rete in un'unica entità AI gestita.

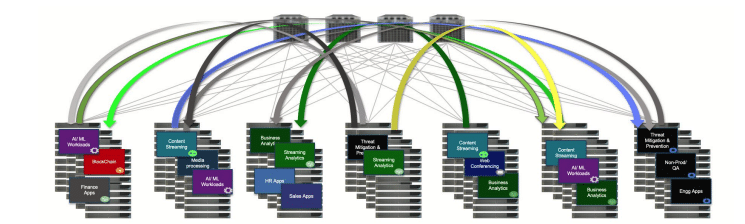

Arista Networks ha annunciato una dimostrazione tecnologica innovativa per creare data center AI che allineano i domini di elaborazione e di rete in un'unica entità AI gestita. Questa iniziativa, intrapresa in collaborazione con NVIDIA, mira a costruire reti di intelligenza artificiale generativa ottimali che offrano tempi di completamento dei lavori inferiori consentendo ai clienti di configurare, gestire e monitorare in modo uniforme i cluster di intelligenza artificiale su componenti critici, tra cui reti, schede di rete e server.

Gestione unificata per cluster AI

Poiché i cluster AI e i modelli linguistici di grandi dimensioni (LLM) continuano ad espandersi, anche la complessità e il numero di componenti coinvolti aumentano in modo significativo. Questi componenti includono GPU, NIC, switch, ottica e cavi, che devono funzionare in modo coeso per formare una rete completa. Controlli uniformi garantiscono che i server AI che ospitano NIC e GPU siano sincronizzati con gli switch di rete AI su vari livelli. Senza questo allineamento, esiste il rischio di errata configurazione o disallineamento, in particolare tra le schede NIC e gli switch di rete, che può influire gravemente sul completamento del lavoro a causa di problemi di rete difficili da diagnosticare.

Gestione coordinata della congestione

I cluster AI di grandi dimensioni richiedono una gestione sincronizzata della congestione per prevenire la perdita di pacchetti e il sottoutilizzo delle GPU. Sono inoltre necessari gestione e monitoraggio coordinati e simultanei per ottimizzare le risorse di elaborazione e di rete. Al centro della soluzione di Arista c'è un agente basato su EOS che consente la comunicazione tra la rete e l'host, coordinando le configurazioni per ottimizzare i cluster AI.

Agente AI remoto per un controllo avanzato

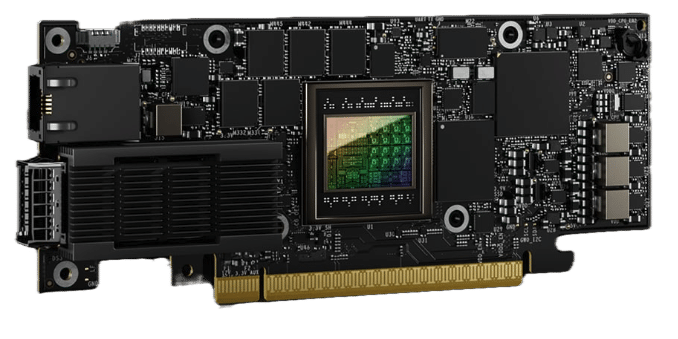

L'EOS Arista in esecuzione sugli switch Arista può essere esteso a NIC e server collegati direttamente tramite un agente AI remoto. Ciò consente un unico punto di controllo e visibilità in un data center AI, creando una soluzione unificata. L'agente AI remoto, ospitato su un SuperNIC NVIDIA BlueField-3 o in esecuzione sul server e raccogliendo dati di telemetria dal SuperNIC, consente a EOS sullo switch di rete di configurare, monitorare ed eseguire il debug dei problemi di rete sul server. Ciò garantisce la configurazione della rete end-to-end e la coerenza della qualità del servizio (QoS), consentendo la gestione e l'ottimizzazione dei cluster AI come una soluzione coesa.

John McCool, Chief Platform Officer di Arista Networks, ha dichiarato: "Arista mira a migliorare l'efficienza della comunicazione tra la rete rilevata e la topologia della GPU per migliorare i tempi di completamento del lavoro attraverso orchestrazione, configurazione, convalida e monitoraggio coordinati del calcolo accelerato NVIDIA e degli NVIDIA SuperNIC e l'infrastruttura di rete Arista."

Questa nuova tecnologia evidenzia come un agente AI remoto basato su Arista EOS consenta di gestire un cluster AI integrato come un’unica soluzione. Estendendo le funzionalità EOS a server e SuperNIC tramite agenti AI remoti, Arista garantisce il monitoraggio e il reporting continui di problemi di prestazioni o guasti tra host e reti, consentendo un rapido isolamento e la riduzione al minimo degli impatti. Gli switch di rete basati su EOS mantengono una consapevolezza costante dell'accurata topologia della rete e l'estensione di EOS a SuperNIC e server con l'agente AI remoto migliora l'ottimizzazione coordinata della QoS end-to-end su tutti gli elementi del data center AI, riducendo in definitiva i tempi di completamento dei lavori .

Prossimo appuntamento per Arista Networks

Arista Networks presenterà la tecnologia dell'agente AI in occasione della celebrazione del decimo anniversario dell'IPO di Arista al NYSE il 10 giugno, con l'inizio delle prove sui clienti previsto nella seconda metà del 5. Questa dimostrazione rappresenta un passo significativo verso il raggiungimento di un prodotto multi-vendor e interoperabile. ecosistema che consente controllo e coordinamento senza soluzione di continuità tra la rete AI e l'infrastruttura di calcolo AI, rispondendo alle crescenti richieste di carichi di lavoro AI e LLM.

Interagisci con StorageReview

Newsletter | YouTube | Podcast iTunes/Spotify | Instagram | Twitter | TikTok | RSS feed