Microsoft packade upp flera nya utvecklingar inom anpassad chipdesign och AI-infrastruktur under veckans Microsoft Ignite-event, inklusive att utöka sin silikonportfölj.

Microsoft tillkännagav flera nyckelutvecklingar inom anpassad chipdesign och AI-infrastruktur vid Ignite 2024. Företaget utökar sin kiselportfölj med nya säkerhets- och databearbetningschips samtidigt som det förbättrar sitt partnerskap med NVIDIA för AI-beräkningar. Dessa uppdateringar syftar till att förbättra effektivitet, säkerhet och prestanda i Microsofts molntjänster.

Microsofts Custom Silicon Revolution

Microsoft utökar avsevärt sin anpassade kiselportfölj utöver Azure Maia AI-acceleratorer och Azure Cobalt-processorer. De har introducerat Azure Integrated HSM, ett internt säkerhetschip designat för att förbättra nyckelhanteringen utan att kompromissa med prestanda. Under 2025 kommer Microsoft att lägga till HSM-säkerhetsmodulen i alla nya datacenterservrar för att skydda konfidentiella och allmänna arbetsbelastningar.

Microsoft introducerade också Azure Boost DPU, dess första databehandlingsenhet. Detta specialiserade chip hanterar datacentrerade arbetsbelastningar med exceptionell effektivitet. Nya servrar med denna DPU kommer att minska strömförbrukningen med två tredjedelar och prestera fyra gånger bättre än nuvarande servrar.

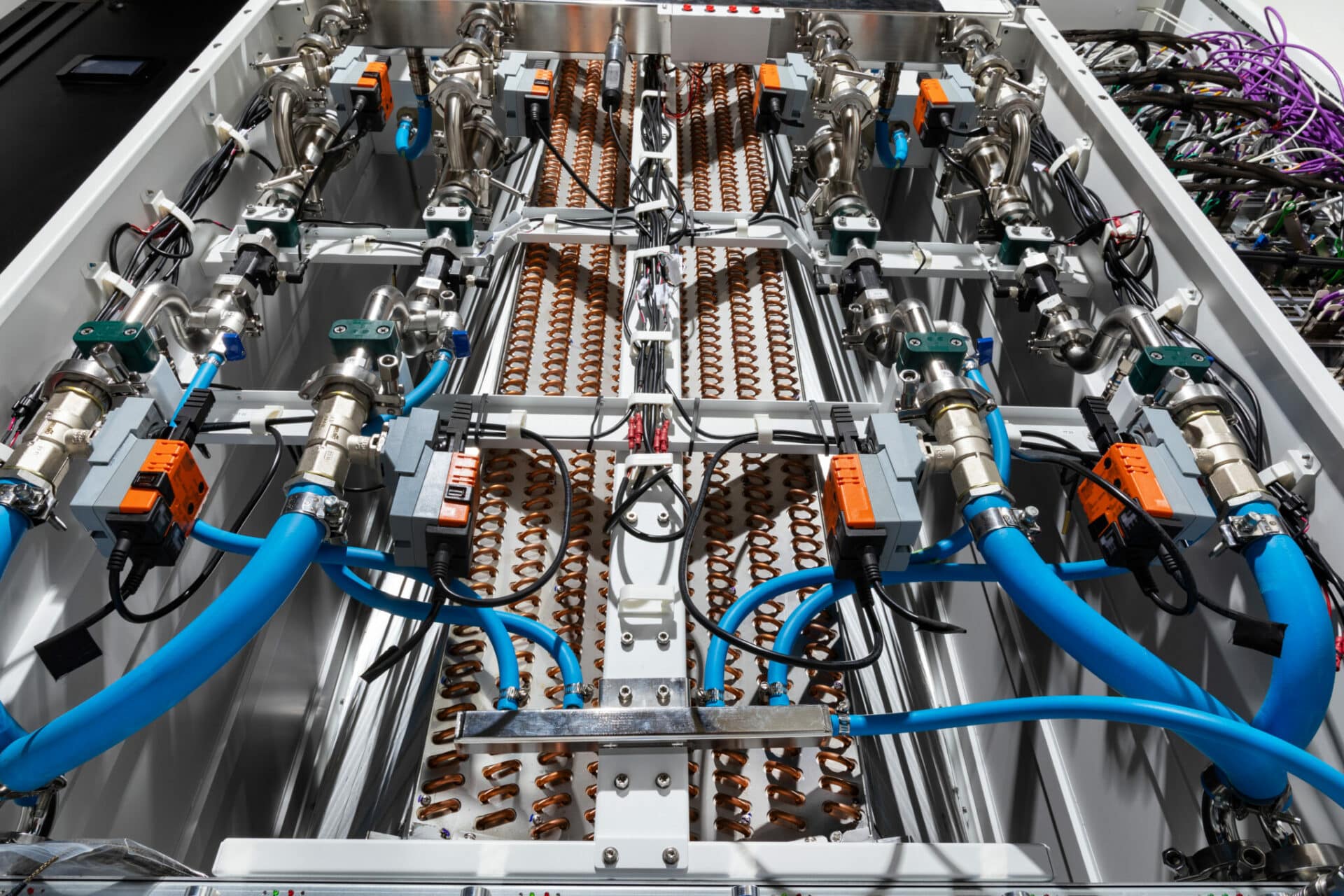

Infrastruktur för kylning och kraft

Microsoft har visat upp sitt nästa generations "sidekick"-ställ för flytande kylning. Denna värmeväxlarenhet kan eftermonteras i Azures datacenter för att stödja storskaliga AI-system, inklusive NVIDIAs GB200-infrastruktur. De har också samarbetat med Meta om en disaggregerad kraftrackdesign med 400-volts likström, vilket möjliggör upp till 35 % fler AI-acceleratorer i varje serverrack.

I ett steg mot branschomfattande framsteg, öppnar Microsoft dessa kylnings- och kraftrackspecifikationer genom Open Compute Project, vilket gör att hela branschen kan dra nytta av dessa innovationer.

Nästa generations AI och datorinfrastruktur

Azures AI-infrastruktur fortsätter att utvecklas med introduktionen av ND H200 V5 Virtual Machine-serien, med NVIDIAs H200 GPU:er. Plattformen har visat anmärkningsvärda prestandaförbättringar och överträffat branschens benchmarking-standard med en faktor två mellan NVIDIA H100 och H200 GPU:er.

Microsoft har också tillkännagett Azure ND GB200 v6, en ny AI-optimerad VM-serie som innehåller NVIDIA GB200 NVL 72 rack-skala design med Quantum InfiniBand-nätverk. Detta framsteg möjliggör AI-superdatorprestanda i stor skala och kopplar samman tiotusentals Blackwell GPU:er.

För CPU-baserad superdatorer lovar de nya virtuella Azure HBv5-datorerna, som drivs av anpassade AMD EPYC™ 9V64H-processorer, upp till åtta gånger snabbare prestanda än nuvarande alternativ och kommer att vara tillgängliga för förhandsvisning 2025.

Azure Container Apps och NVIDIA Integration

Azure Container Apps stöder nu NVIDIA GPU:er, vilket möjliggör förenklad och skalbar AI-distribution. Denna serverlösa containerplattform förenklar driftsättning och hantering av mikrotjänsterbaserade applikationer genom att abstrahera bort den underliggande infrastrukturen. Med fakturering per sekund och skala-till-noll-funktioner betalar kunderna endast för den dator de använder, vilket säkerställer ekonomiskt och effektivt resursutnyttjande.

NVIDIA AI-plattformen på Azure inkluderar nya referensarbetsflöden för industriell AI och NVIDIA Omniverse Blueprint för att skapa uppslukande, AI-driven grafik. Ett referensarbetsflöde för 3D-fjärrövervakning av industriell verksamhet kommer snart, vilket gör det möjligt för utvecklare att ansluta fysiskt korrekta 3D-modeller av industrisystem till realtidsdata från Azure IoT Operations och Power BI.

RTX AI-datorer och avancerad datoranvändning

NVIDIA tillkännagav sin nya multimodala SLM, NVIDIA Nemovision-4B Instruct, för att förstå visuella bilder i den verkliga världen och på skärmen. Denna teknik, som snart kommer att introduceras till RTX AI-datorer och arbetsstationer, kommer att förbättra digitala mänskliga interaktioner med större realism.

Uppdateringar av NVIDIA TensorRT Model Optimizer (ModelOpt) erbjuder nu Windows-utvecklare en förbättrad väg att optimera modeller för ONNX Runtime-distribution. Detta gör det möjligt för utvecklare att skapa AI-modeller för datorer som är snabbare och mer exakta när de accelereras av RTX GPU:er samtidigt som det gör det enkelt att distribuera över PC:s ekosystem med ONNX körtider.

Över 600 Windows-appar och -spel kör AI lokalt på över 100 miljoner GeForce RTX AI-datorer världen över, vilket ger snabb, pålitlig prestanda med låg latens. Samarbetet mellan NVIDIA och Microsoft fortsätter att driva innovation inom persondatorenheter, vilket ger sofistikerade AI-funktioner till vardagliga användare.

Microsoft Cloud och Hybrid Infrastructure

Microsofts engagemang för multimoln- och hybridlösningar exemplifieras av Azure Arc, som nu betjänar över 39,000 XNUMX kunder globalt. Nya Azure Local levererar säker molnansluten hybridinfrastruktur med flexibla alternativ, inklusive GPU-servrar för AI-inferencing.

Microsoft har också tillkännagett Windows Server 2025 och SQL Server 2025, och utnyttjar Azure Arc för att leverera molnfunktioner över lokala och molnmiljöer. SQL Server 2025 sticker ut med sina nya inbyggda AI-funktioner, som förenklar AI-applikationsutveckling och RAG-mönster med vektorstöd.

Slutsats

Microsofts senaste innovationer understryker dess engagemang för att utveckla anpassad kisel, AI-infrastruktur och hybridmolnlösningar. Med banbrytande utvecklingar som Azure Integrated HSM och Azure Boost DPU sätter Microsoft en ny mall för säker, effektiv och högpresterande datacenterdrift. Introduktionen av nästa generations kyl- och kraftteknik och innovationer med öppen källa visar Microsofts engagemang för att främja industrisamarbete och hållbarhet.

Utvecklingen av Azures AI och datorinfrastruktur, inklusive de virtuella maskinerna ND H200 V5 och ND GB200 v6, visar Microsofts förmåga att leverera AI-prestanda i stor skala. Samtidigt lovar de nya virtuella maskinerna HBv5 prestanda för CPU-baserad superdator, vilket säkerställer att Azure förblir ledande inom högpresterande datoranvändning.

Slutligen, med Azure Arcs robusta hybridfunktioner och introduktionen av AI-förbättrade verktyg som SQL Server 2025, utrustar Microsoft företag med flexibla, skalbara lösningar för att hantera komplexiteten i moderna arbetsbelastningar. Tillsammans befäster dessa framsteg Microsofts position som ledande när det gäller att driva framtiden för AI, moln och hybridinfrastruktur.

Engagera dig med StorageReview

Nyhetsbrev | Youtube | Podcast iTunes/Spotify | Instagram | Twitter | TikTok | Rssflöde