WEKAs förstärkta minne för AI-inferens ökar GPU-effektiviteten, minskar latens och kostnad samtidigt som AI-modeller skalas för företagsarbetsbelastningar.

WEKA har meddelat sin strategiska integration med referensdesignen för NVIDIA AI Data Platform. Den uppnådde kritiska NVIDIA-lagringscertifieringar för att tillhandahålla optimerad infrastruktur som är uttryckligen skräddarsydd för agent AI och komplexa resonemangsmodeller. Parallellt med detta tillkännagivande introducerade WEKA sin innovativa Augmented Memory Grid-kapacitet och ytterligare NVIDIA Cloud Partner (NCP) Reference Architectures-certifieringar, inklusive NVIDIA GB200 NVL72 och NVIDIA-certifierad systemlagring för fabriksinstallationer av AI i företagsskala.

Accelererande AI-agenter

NVIDIA AI-dataplattformen representerar ett betydande steg framåt i företagens AI-infrastruktur, och integrerar sömlöst NVIDIA Blackwell-arkitekturen, NVIDIA BlueField DPU:er, Spectrum-X-nätverk och NVIDIA AI Enterprise-programvaran. Genom att para ihop den här avancerade NVIDIA-infrastrukturen med WEKA Data Platform kan företag distribuera en massivt skalbar lagringsbas som är designad specifikt för högpresterande AI-inferensarbetsbelastningar.

Denna integrerade lösning möter direkt de växande kraven från företags-AI och ger AI-frågeagenter sömlös, accelererad tillgång till kritisk affärsintelligens, vilket resulterar i avsevärt förbättrad slutledningsprestanda och resonemangsnoggrannhet. WEKA:s dataplattform säkerställer att AI-system snabbt kan omvandla data till handlingsbar intelligens, vilket stöder det sofistikerade resonemang som krävs av nästa generations AI-modeller.

WEKA Augmented Memory Grid

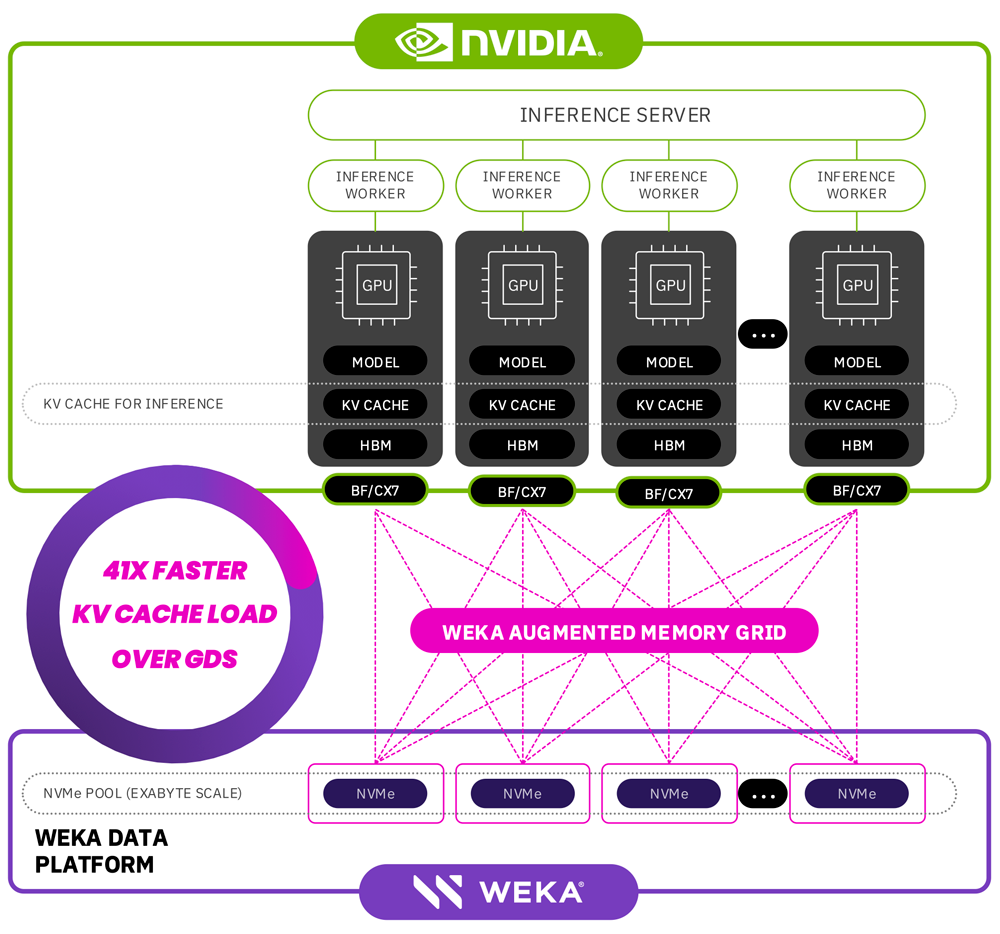

Agentiska AI-modeller utvecklas kontinuerligt och kan hantera större sammanhangsfönster, expansiva parameterantal och mer betydande minneskrav. Dessa framsteg tänjer ofta på gränserna för traditionell GPU-minneskapacitet, vilket skapar flaskhalsar i AI-inferens. WEKA tar itu med dessa utmaningar med sin banbrytande Augmented Memory Grid-lösning, en innovation som utökar tillgängligt minne för AI-arbetsbelastningar och ger ökningar i petabyte-skala – långt bortom nuvarande begränsningar på en terabyte.

WEKAs Augmented Memory Grid förbättrar AI-inferensen avsevärt genom att kombinera WEKAs dataplattformsmjukvara med NVIDIAs accelererade dator- och nätverksteknologier. Denna kombination möjliggör nästan minneshastighetsåtkomst med mikrosekunders latens, vilket dramatiskt förbättrar tokenbearbetningsprestanda och total AI-inferenseffektivitet.

Viktiga fördelar med WEKAs Augmented Memory Grid inkluderar:

-

Dramatiskt reducerad latens: I tester som involverade 105,000 41 tokens, levererade WEKAs Augmented Memory Grid en anmärkningsvärd XNUMXx förbättring av tid till första token jämfört med traditionella omräkningsmetoder.

-

Optimerad token-genomströmning: WEKAs lösning hanterar effektivt slutledningsarbetsbelastningar över kluster, och uppnår högre tokengenomströmning till en reducerad total kostnad, vilket sänker kostnaden per token som behandlas med upp till 24 % i hela systemet.

Dessa prestandavinster leder direkt till ökad ekonomisk effektivitet, vilket gör det möjligt för företag att accelerera AI-driven innovation utan att kompromissa med modellkapacitet eller infrastrukturprestanda.

WEKApod Nitro

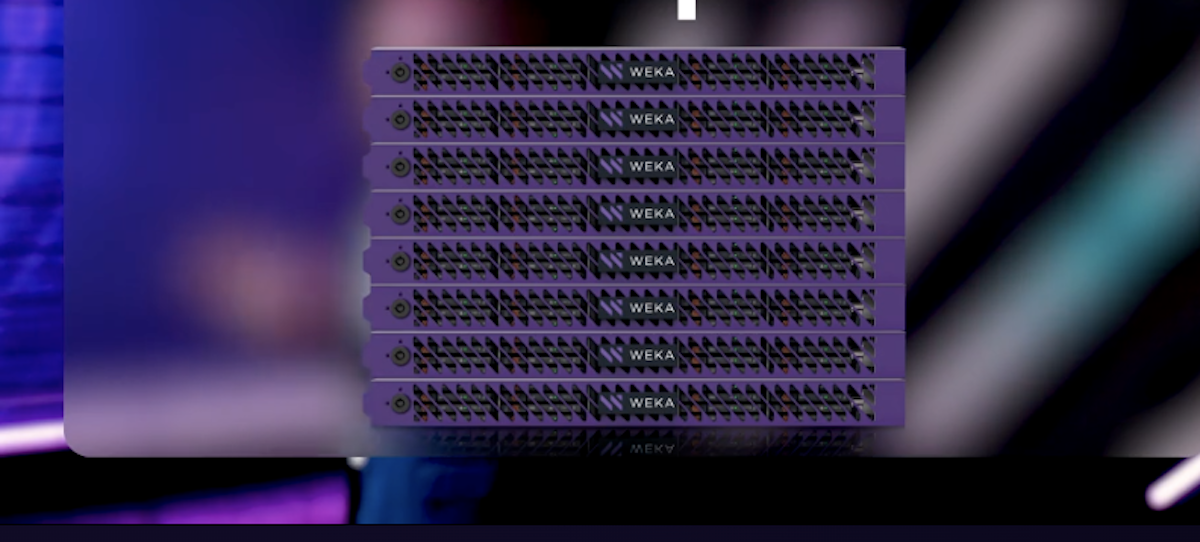

WEKApod Nitro Data Platform-apparater har fått flera NVIDIA-certifieringar, vilket etablerar WEKA som en ledande högpresterande lagringsleverantör för företags-AI:

-

NVIDIA Cloud Partner (NCP)-certifiering: WEKApod Nitro är bland de första lagringslösningarna som är certifierade för NVIDIAs NCP Reference Architectures, inklusive HGX H200, B200 och GB200 NVL72. Dessa apparater ger tjänsteleverantörer och utvecklare stöd genom att stödja massiva GPU-kluster – upp till 1,152 8 GPU:er i en XNUMXU-konfiguration – samtidigt som de bibehåller exceptionell prestandatäthet och energieffektivitet.

-

NVIDIA-certifierad systemlagringsbeteckning: WEKApod Nitro-apparater har fått NVIDIAs nya företagslagringscertifiering, vilket säkerställer kompatibilitet med NVIDIA Enterprise Reference Architectures och bästa praxis. Denna beteckning bekräftar att WEKA:s dataplattform levererar optimal lagringsprestanda, effektivitet och skalbarhet för krävande företags-AI och HPC-distributioner.

Nilesh Patel, WEKA:s Chief Product Officer, betonade den transformativa potentialen i detta partnerskap med NVIDIA. Patel jämförde denna utveckling med genombrott inom flyg- och rymdbranschen, "Precis som att bryta ljudbarriären låste upp nya gränser, krossar WEKAs Augmented Memory Grid AI-minnesbarriären, vilket dramatiskt utökar GPU-minnet och optimerar tokeneffektiviteten. Denna innovation förvandlar i grunden AI-tokens ekonomi, vilket möjliggör prestanda utan att ge upphov till snabbare innovation och lägre kostnader."

Rob Davis, Vice President för Storage Networking Technology på NVIDIA, betonade ytterligare vikten av denna integration: "Företag som distribuerar agent AI och resonemangsmodeller kräver oöverträffad effektivitet och skalbarhet. Kombinationen av NVIDIA- och WEKA-teknik säkerställer att AI-agenter kan komma åt och bearbeta data med oöverträffad hastighet och noggrannhet under slutledning."

Tillgänglighet

- WEKA:s NCP-referensarkitektur för NVIDIA Blackwell-system kommer att finnas tillgänglig i mars.

- WEKA Augmented Memory Grid-kapaciteten kommer att vara allmänt tillgänglig för WEKA Data Platform-kunder under våren 2025.

Engagera dig med StorageReview

Nyhetsbrev | Youtube | Podcast iTunes/Spotify | Instagram | Twitter | TikTok | Rssflöde