Oracle CloudWorld 컨퍼런스 참석자들은 Oracle Cloud Infrastructure이 최초의 제타스케일 OCI 슈퍼클러스터를 공개하는 모습을 지켜봤습니다.

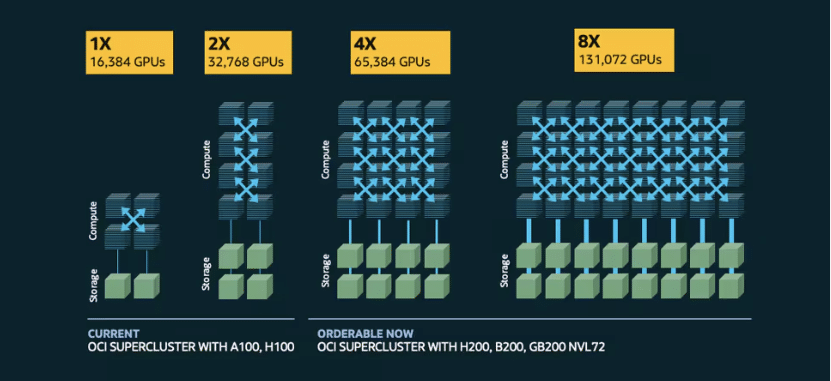

Oracle CloudWorld 컨퍼런스에서 오라클 클라우드 인프라(OCI) NVIDIA Blackwell 플랫폼으로 구동되는 최초의 제타스케일 OCI 슈퍼클러스터를 공개했습니다. 이 솔루션은 기업이 AI 워크로드와 데이터 처리를 가속화하고 NVIDIA의 최신 세대 GPU 100,000개 이상을 활용하도록 돕기 위해 만들어졌습니다. 이러한 슈퍼클러스터는 온프레미스, 퍼블릭 또는 주권 클라우드 환경 여부에 관계없이 배포에 유연성을 제공합니다.

최대 규모에서 OCI 슈퍼클러스터는 Frontier 슈퍼컴퓨터보다 131,072배 이상 많은 GPU를 제공하고 다른 하이퍼스케일러보다 2.4배 이상 많은 GPU를 제공합니다. 이러한 시스템은 7개의 Blackwell GPU로 확장할 수 있으며 NVIDIA ConnectX-2 NIC 및 Quantum-2025 InfiniBand 네트워킹을 통해 최대 XNUMX제타플롭의 AI 컴퓨팅을 제공합니다. Blackwell 기반 시스템은 XNUMX년 상반기에 출시될 예정입니다.

NVIDIA GB200 NVL72 액체 냉각 베어 메탈 인스턴스 미리보기

Oracle은 또한 이를 미리 보여주었습니다. 엔비디아 GB200 NVL72 회의에서 액체 냉각 베어 메탈 인스턴스를 선보였는데, 이는 생성 AI 애플리케이션을 위해 설계되었습니다. 이러한 인스턴스는 대규모 AI 교육과 72조 개의 매개변수 모델에 대한 실시간 추론을 가능하게 하며, 확장된 200개 GPU NVIDIA NVLink 도메인을 통해 단일의 거대한 GPU 역할을 합니다. 또한 OCI는 단일 베어 메탈 인스턴스에서 65,536개의 GPU를 연결할 수 있는 NVIDIA HGX H200 Tensor Core GPU의 출시를 발표했으며, 이를 통해 기업은 최대 XNUMX개의 HXNUMX GPU까지 확장할 수 있습니다. 이러한 제품은 실시간 AI 추론과 대규모 교육을 가속화할 것으로 기대됩니다.

NVIDIA L40S GPU 가속 인스턴스 소개

중간 범위 AI 워크로드의 경우 Oracle은 일반 가용성을 도입했습니다. 엔비디아 L40S GPU-가속화된 인스턴스. Oracle의 에지 솔루션은 또한 원격 또는 연결이 끊긴 위치에서도 최대 2개의 NVIDIA L4 Tensor Core GPU를 지원하는 Roving Edge Device vXNUMX를 포함하여 확장 가능한 AI 배포를 제공합니다.

기업은 이미 AI 혁신을 위해 OCI 슈퍼클러스터를 활용하고 있습니다. 기초 모델 스타트업인 Reka는 이러한 클러스터를 사용하여 엔터프라이즈 에이전트를 위한 고급 멀티모달 AI 모델을 개발하고 있습니다. Reka의 공동 창립자이자 CEO인 다니 요가타마에 따르면, 이 인프라를 통해 클러스터 수준에서 훈련을 확장하는 동시에 대규모 모델과 컨텍스트를 효율적으로 처리할 수 있습니다.

Oracle과 NVIDIA는 또한 Oracle Autonomous Database에서 생성적 AI 워크로드를 가속화하기 위한 새로운 통합을 선보였습니다. 이러한 통합은 NVIDIA GPU가 Oracle 데이터베이스에서 AI 기능을 어떻게 향상시킬 수 있는지 강조합니다. 데모에는 대량 벡터 임베딩 가속화, 벡터 그래프 인덱스 생성 최적화, NVIDIA NIM 추론 마이크로서비스를 통한 텍스트 생성 및 변환 향상이 포함되었습니다. 이러한 혁신을 통해 기업은 Oracle 데이터베이스 내에서 구조화되고 구조화되지 않은 데이터 관리에 AI를 원활하게 통합할 수 있습니다.

데이터 상주 문제 해결

글로벌 규모로 Oracle과 NVIDIA는 주권적 AI 인프라를 제공하기 위해 협력하고 있으며, 정부와 기업의 데이터 상주 요구 사항을 해결하고 있습니다. 브라질에 본사를 둔 스타트업 Wide Labs는 OCI의 브라질 데이터 센터에서 NVIDIA H100 Tensor Core GPU와 NeMo 프레임워크를 사용하여 브라질 포르투갈어를 위한 대규모 언어 모델인 Amazônia IA를 만들어 데이터 주권을 보장했습니다. 마찬가지로 일본의 Nomura Research Institute는 NVIDIA GPU가 있는 OCI의 Alloy 인프라를 사용하여 금융 규정과 데이터 주권 요구 사항을 준수하면서 LLM으로 금융 AI 플랫폼을 개선하고 있습니다. Zoom도 현지 데이터 규정을 준수하기 위해 OCI의 사우디 아라비아 데이터 센터에서 NVIDIA GPU를 활용하고 있습니다.

지리공간 모델링 회사 RSS-Hydro는 NVIDIA 기반 OCI 인프라를 사용하여 일본 구마모토 지역의 홍수 영향을 시뮬레이션하고 있습니다. 이는 디지털 트윈 기술을 통해 AI가 기후 변화 완화 노력에 어떻게 적용될 수 있는지 보여줍니다.

기업은 NIM 마이크로서비스 및 NVIDIA cuOpt와 같은 NVIDIA 소프트웨어를 사용하여 OCI에서 작업 자동화를 가속화할 수도 있습니다. 이러한 솔루션을 통해 기업은 코드 생성 및 경로 최적화와 같은 작업에 생성적 AI를 신속하게 도입할 수 있습니다. 이러한 도구를 포함하는 NVIDIA의 AI Enterprise 소프트웨어 플랫폼은 Oracle Cloud Marketplace에서 제공되며, 기업에 AI 기반 워크플로 및 에이전트 프로세스를 개선하기 위한 강력한 리소스를 제공합니다.

StorageReview에 참여

뉴스레터 | 유튜브 | 팟캐스트 iTunes/스포티 파이 | 인스타그램 | 트위터 | 틱톡 서비스 | RSS 피드